·对比备受热捧的H100芯片,新的H200完成了1.4倍内存带宽和1.8倍内存容量的升级,提高了处理密集生成式人工智能负载的能力。据介绍,在处理Meta的大语言模型Llama2(700亿参数)时,H200的推理速度比H100提高了2倍。

·第一批H200芯片将于2024年第二季度上市。

第一批H200芯片将于2024年第二季度上市。

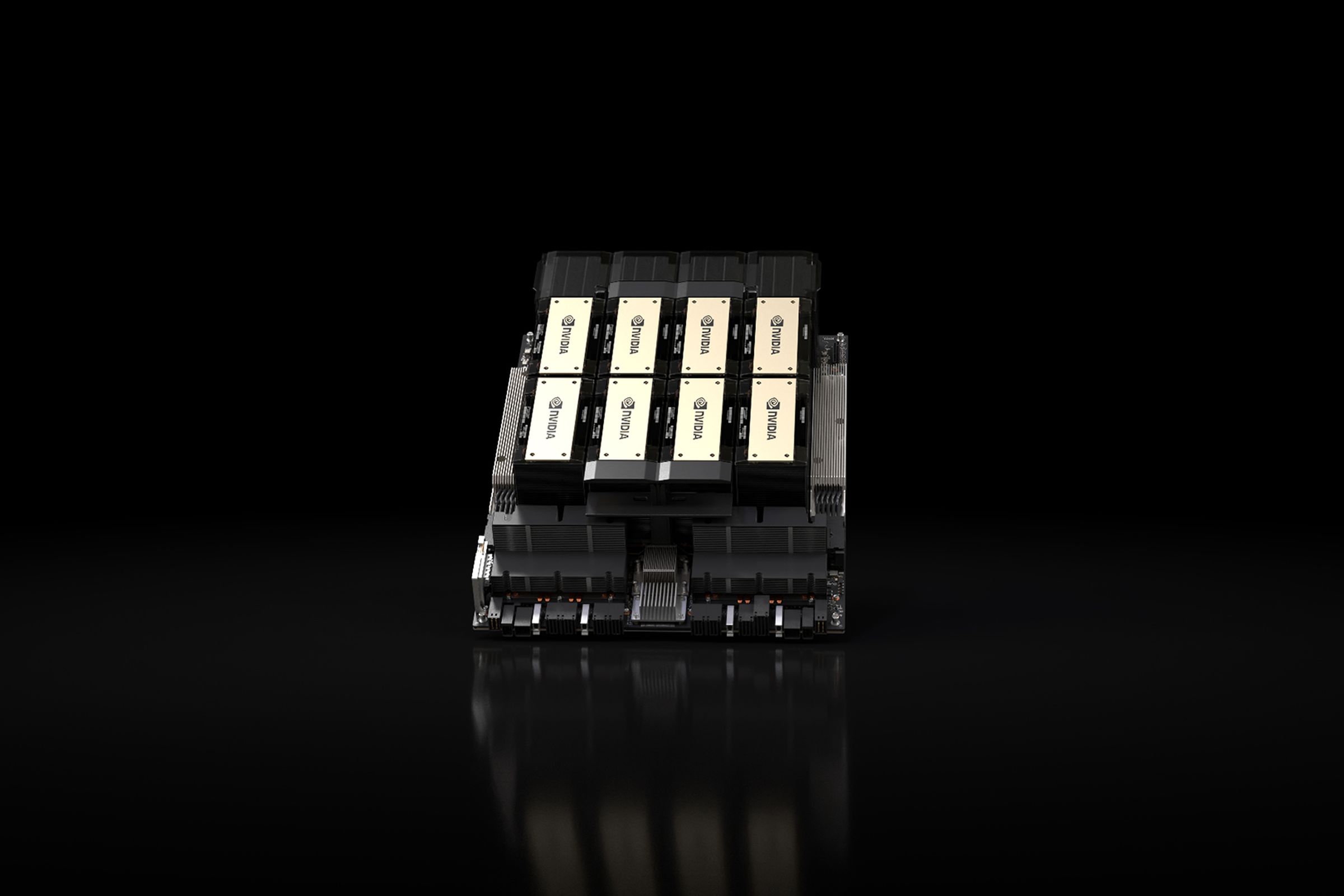

北京时间11月14日凌晨,英伟达在今年的SC23大会上突然宣布,推出新的顶级AI芯片HGX H200。第一批H200芯片将于2024年第二季度上市。

英伟达又一次自己超越自己,H200取代H100成为新的世界最强AI芯片。

对比备受热捧的H100芯片,这款新的GPU(图形处理单元)完成了1.4倍内存带宽和1.8倍内存容量的升级,提高了处理密集生成式人工智能负载的能力。据介绍,在处理Meta的大语言模型Llama2(700亿参数)时,H200的推理速度比H100提高了2倍。

从外观上看,H200似乎与H100基本相同。内存方面,H200芯片是第一款采用HBM3e(新型超高速高带宽内存)的GPU。HBM3e可加速生成式AI和大语言模型工作负载,将GPU的内存带宽提高到每秒4.8TB,而H100为每秒3.35TB,同时将其总内存容量提高到141GB,而其前身为80GB。与再前一代的A100相比,其容量翻倍,带宽增加2.4倍。

对于高性能计算(HPC),显存带宽也至关重要,其可以实现更快的数据传输,减少复杂任务的处理瓶颈。对于模拟、科学研究和人工智能等显存密集型HPC应用,H200更高的显存带宽可确保高效地访问和操作数据。据介绍,相较于H100,H200在处理高性能计算的应用程序上有20%以上的提升。

英伟达大规模与高性能计算副总裁伊恩·巴克(Ian Buck)在演示视频中表示,“HBM内存的整合有助于加速计算密集任务的性能,包括生成式人工智能模型和高性能计算应用,同时优化GPU的利用率和效率。”“借助H200,业界领先的端到端人工智能超算平台的速度会变得更快,一些世界上最重要的挑战,都可以被解决。”

H200还与支持H100的系统兼容。英伟达表示,云服务提供商在添加H200时无需进行任何更改。亚马逊、谷歌、微软和甲骨文等公司的云服务部门将是明年首批接收新GPU的公司。

除了各种芯片性能升级外,一个重要的关注点在于公司是否能够得到这些新芯片,或者它们是否会像H100一样受到供应限制。对于这个问题,英伟达并没有确切的答案。该公司表示正在与“全球系统制造商和云服务提供商”合作,以使其可用。英伟达发言人克里斯汀·内山(Kristin Uchiyama)拒绝就生产数量发表评论。

此外,价格也是核心焦点。英伟达目前没有列出新芯片的价格,内山表示定价由英伟达的合作伙伴确定。据美国媒体CNBC报道,上一代H100估计每个售价在25000到40000美元之间,要想在最高水平上运行,可能需要数千个H100芯片。

目前全球的人工智能公司还面临着“算力荒”,急切寻找H100芯片成为常态(H100被视为高效训练和运行生成式人工智能和大语言模型的最佳选择)。这些芯片已经成为了“硬通货”,甚至有公司将H100芯片用作贷款的抵押品,在硅谷谁拥有多少H100芯片也是热门的八卦话题。

内山在接受科技媒体The Verge的采访中表示,H200的推出不会影响H100的生产,“你将看到我们在整个年度增加总体供应”。据《金融时报》8月报道,英伟达计划在2024年将H100的生产量增加到三倍,目标是明年生产200万个(2023年生产约50万个)。