·亚马逊云科技(AWS)成为第一家在云端配备英伟达GH200 Grace Hopper超级芯片的云厂商,并将在其平台上推出英伟达DGX Cloud NVIDIA AI“训练即服务”。两家公司将合作推出Project Ceiba,构建全球最快的GPU驱动的AI超级计算机。

·云计算领域正在经历一场激烈的霸主争夺战,AWS和微软处于这场竞争的最前沿,两者都在定制芯片上下了功夫,也都采取了某种“双管齐下”的思路:既推出自研芯片,也同时提供英伟达最新AI芯片这样的可选项。

太平洋时间11月28日,亚马逊云科技在美国拉斯维加斯举办2023 re:Invent全球大会。

太平洋时间11月28日,亚马逊云科技(Amazon Web service,AWS)在美国拉斯维加斯举办的2023 re:Invent全球大会上宣布,与英伟达扩大战略合作,将联合推出先进的基础设施、软件及服务,推动客户在生成式AI(Generative AI)的创新。

AWS还宣布推出专为训练人工智能系统而设计的第二代芯片Trainium2,以及通用Graviton4处理器。

云计算领域正在经历一场激烈的霸主争夺战,AWS和微软处于这场竞争的最前沿,两者都在定制芯片上下了功夫,也都采取了某种“双管齐下”的思路。

首家在云端配备英伟达GH200

亚马逊云科技首席执行官亚当·塞利普斯基(Adam Selipsky)表示,“亚马逊云科技与英伟达合作已经超过13年,我们的合作起源于推出全球首个配置GPU(图形处理器)的云端实例。现在我们推出最广泛的英伟达GPU解决方案,可用于各种工作负载,包括绘图、游戏、HPC高性能计算、机器学习,直到现在的生成式AI。”

英伟达创始人兼首席执行官黄仁勋也穿着标志性皮衣出现在发布会现场,他在与塞利普斯基对话时说,“生成式AI正改变各种云端负载,为多元内容创作在底层注入加速计算动能。我们的共同目标是为每个客户提供具有成本效益的先进生成式AI,为此英伟达与亚马逊云科技在整个计算堆栈展开合作,横跨AI基础设施、加速库(acceleration libraries)、基础模型以及生成式AI服务。”

双方将英伟达与亚马逊云科技技术优势相结合,为训练基础模型和构建生成式AI应用提供理想环境,具体包含英伟达新一代GPU、CPU(中央处理器)与AI软件的最新多节点系统,以及亚马逊云科技的Nitro System先进虚拟化与安全平台、Elastic Fabric Adapter(EFA)互连技术和UltraCluster(超大规模集群)扩展能力。

亚马逊云科技与英伟达此次扩大合作主要包括四个方面:

·亚马逊云科技成为第一家在云端配备英伟达GH200 Grace Hopper超级芯片的云厂商。英伟达GH200 NVL32多节点平台为运用英伟达NVLink与NVSwitch技术连接32个Grace Hopper Superchips组成的实例。此平台将在Amazon Elastic Compute Cloud(Amazon EC2)实例上可用,与亚马逊的网络相连,由虚拟化(Amazon Nitro System)及超大规模集群(Amazon EC2 UltraClusters)提供支持,让共同客户能扩展至数千个GH200超级芯片。

·在亚马逊云科技平台上将推出英伟达DGX Cloud NVIDIA AI“训练即服务(AI-training-as-a-service)”。此服务将是首个配置GH200 NVL32的DGX Cloud,为开发者提供单一实例中最多的共享内存。在亚马逊云科技上运行的DGX Cloud将加速训练含有超过1兆参数的尖端生成式AI与大型语言模型。

·英伟达与亚马逊云科技合作推动Project Ceiba,构建全球最快的GPU驱动的AI超级计算机,这是一个配备GH200 NVL32与Amazon EFA互连技术的大规模系统,该系统部署在亚马逊云科技上,为英伟达研发团队提供服务。该超级计算机将前所未有地配置16384颗英伟达H200超级芯片,能处理65 exaflops(衡量超级计算机性能的单位,每秒浮点运算可达一百亿亿次)速度等级的AI运算,英伟达使用该超级计算机推动其全新生成式AI的创新。

·亚马逊云科技将推出三款Amazon EC2实例:P5e实例配置英伟达H200 Tensor Core GPUs,针对大规模与尖端生成式AI及HPC高性能运算工作负载;分别配置英伟达L4 GPUs与英伟达L40S GPUs的G6与G6e实例,可运行包括AI微调、推理、绘图以及影片工作负载等广泛应用。G6e实例特别适用于开发3D工作流程、数字孪生、以及其他使用英伟达Omniverse的应用,用来连结与构建各种生成式AI的3D应用。

据塞利普斯基透露,亚马逊云科技正运用英伟达NeMo框架训练新一代大语言模型Amazon Titan。Amazon Robotics也已开始借助英伟达Omniverse Isaac打造数字孪生,在虚拟化环境中推动自主仓库的自动化、优化以及规划,完成之后再部署到真实环境。

最新自研芯片Trainium2和Graviton4

据塞利普斯基介绍,Trainium2的性能是其前身(2020年12月推出的第一代Trainium)的四倍,能源效率是其前身的两倍。10万个Trainium芯片可提供65 exaflops的计算能力,相当于每个芯片可提供650 teraflops(每秒执行一万亿次浮点运算)的计算能力。

AWS表示,由10万个Trainium芯片组成的集群可以在数周而不是数月内训练出3000亿参数的大语言模型,这大约是OpenAI的大语言模型GPT-3大小的1.75倍。

据AWS介绍,初创公司Databricks和OpenAI竞争对手Anthropic计划使用新的Trainium2芯片构建模型。但AWS没有透露AWS客户何时可以使用Trainium2实例,只是表述为“明年某个时候”。

亚马逊云科技计算和网络副总裁大卫·布朗(David Brown)表示:“芯片是用户所有工作负载的基础……Graviton4是我们在短短五年推出的这一系列的第四代,是我们至今功能最强大和最具能效的芯片。”

AWS发布的第二款芯片是基于Arm架构的自研服务器CPU芯片Graviton4,旨在用于推理。据塞利普斯基介绍,与在Amazon EC2上运行的上一代Graviton处理器Graviton3相比,Graviton4的计算性能提高了30%,核心数量增加了50%,内存带宽增加了75%。

由Graviton4支持的R8g实例已推出预览版,AWS客户目前已可以开始测试该处理器,该实例计划在未来几个月内全面上市。

云计算霸主的“双管齐下”思路

云计算领域正在经历一场激烈的霸主争夺战,AWS和微软处于这场竞争的最前沿,两家巨头都在定制芯片上进行了大量投资。

定制芯片本质上也是对当下生成式人工智能火热,大模型训练和运行所需GPU短缺的应对。据巴伦周刊此前报道,英伟达性能最好的芯片的交付已排到2024年。为了减少对GPU的依赖,有能力负担得起GPU的公司正在开发定制芯片,用于创建、迭代和产品化大模型。

从微软和AWS两个云计算厂商可以观察到一种“双管齐下”的思路:既推出自研芯片,也同时提供英伟达最新AI芯片这样的可选项。此次亚马逊云科技在推出自己推理训练芯片的同时,也提供对英伟达最新AI芯片H200的访问。11月初,微软也采取了类似的思路,推出了首款人工智能芯片Maia 100,并表示微软云(Azure)将配备英伟达H200 GPU。

除此之外,值得注意的是,AWS也展示了其在量子计算领域的一些最新进展,其中包括最新的量子纠错硬件设计,这种新的架构有望用更少的超导组件来产生可控的逻辑量子比特,从而为超大规模量子计算机的构建铺平道路。

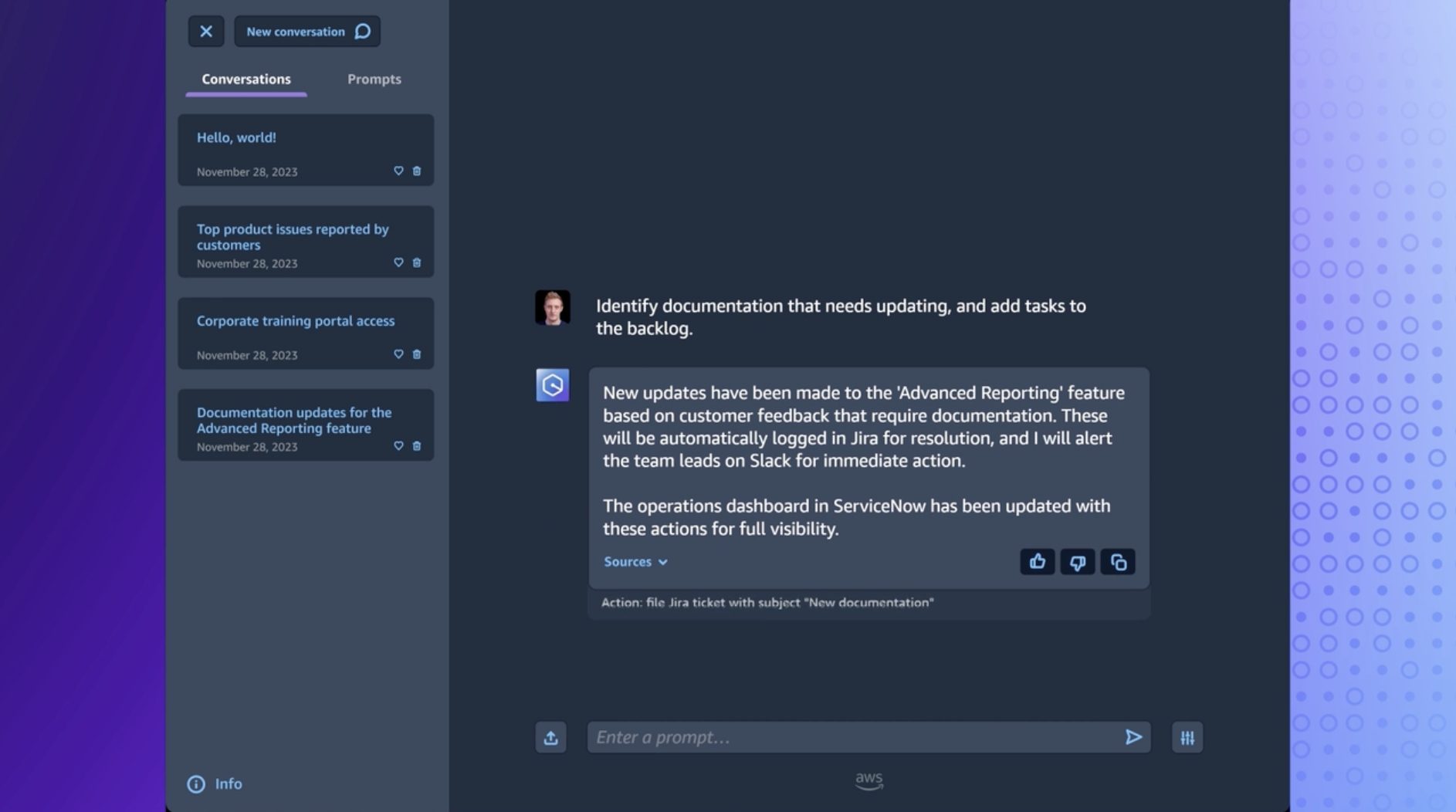

·亚马逊云科技在2023 re:Invent全球大会上推出名为“Amazon Q ”的生成式人工智能助手,可“轻松聊天、生成内容和采取行动”。Amazon Q专注于工作场所,而不是面向消费者。

·考虑到这个聊天机器人的对话特性,Q这个名字来源于“问题”(question)这个词,也是对詹姆斯·邦德小说中角色Q和《星际迷航》中强大人物的模仿。

亚马逊云科技在2023 re:Invent全球大会上推出名为“Amazon Q ”的生成式人工智能助手。

OpenAI有聊天机器人ChatGPT,谷歌有聊天机器人Bard,微软有Copilots,亚马逊也按捺不住,正式加入聊天机器人竞赛。

太平洋时间11月28日,亚马逊云科技(Amazon Web service,AWS)在2023 re:Invent全球大会上推出名为“Amazon Q ”的生成式人工智能助手。在主题演讲中,亚马逊云科技首席执行官亚当·塞利普斯基(Adam Selipsky)将其描述为能够“轻松聊天、生成内容和采取行动”,“一种新型的生成式人工智能助手,旨在工作中为你提供帮助”。

塞利普斯基说,考虑到这个聊天机器人的对话特性,Q这个名字来源于“问题”(question)这个词。这也是对詹姆斯·邦德小说中角色Q和《星际迷航》中强大人物的模仿。

科技领域一直拥有众多《星际迷航》粉丝,包括亚马逊创始人杰夫·贝佐斯。在《星际迷航》里,Q被描述为“虚拟银河系中已知拥有最高智力且已存在很久的种族,拥有对时间、空间、物理定律和现实本身的不可估量的掌控能力,能够随心所欲地改变时空。”

Amazon Q专注于工作场所,而不是面向消费者。它旨在帮助员工完成日常任务,例如总结文档、填写内部文件以及回答有关公司政策的问题。Amazon Q将与其他企业聊天机器人竞争,包括微软Copilot、谷歌Duet AI和ChatGPT Enterprise。

根据亚马逊云科技全球产品副总裁马特·伍德(Matt Wood)的概述,Amazon Q可以利用来自各种应用程序的业务数据,包括办公软件Microsoft 365、企业协作软件Slack、客户服务软件Salesforce、网络储存应用Dropbox和Amazon S3,同时尊重隐私和安全控制以防止未经授权的访问。Amazon Q从客户自己的信息存储库、软件应用程序代码和企业系统中获取知识,旨在简化任务并加快决策和解决问题的速度。

Amazon Q预览版已经上线,部分功能目前免费对外提供。未来,亚马逊最终将向企业用户收取每人每月20美元的费用,而为开发人员和IT人员提供功能的版本将收取每人每月25美元。相对而言,适用于商业工作者的Microsoft 365的Copilo和Google Workspace的Duet AI的费用均为每人每月30美元。

实际上,自微软成功投资OpenAI获得先手优势后,AWS就一直在努力改变其在人工智能竞争中落后的印象。9月,亚马逊宣布将向与OpenAI竞争的AI初创公司Anthropic投资至多40亿美元,共同开发先进计算芯片。

此次推出聊天机器人时,塞利普斯基也强调了如何解决此前竞争对手们推出的聊天机器人饱受批评的安全问题。

“公司有兴趣在工作场所使用聊天机器人,但他们希望确保助手能够保护这些公司数据并保证其信息的私密性。许多公司告诉我,出于安全和隐私方面的考虑,他们已禁止在企业中使用这些人工智能助手。”塞利普斯基说。

作为回应,塞利普斯基表示,亚马逊打造了比面向消费者聊天机器人更安全、更私密的Amazon Q。例如,Amazon Q可以同步企业客户已经为其用户设置的相同的安全权限,比如在一家公司,营销部门的员工可能无法获得敏感的财务预测,Q可以效仿这种做法,在被要求时不向该员工提供此类财务数据。企业还可以允许Amazon Q处理不在亚马逊服务器上的企业数据,比如连接Slack和电子邮箱Gmail。

与ChatGPT和Bard不同,Amazon Q并不是建立在特定的人工智能模型上,而是使用了AWS的Bedrock平台,该平台将几个人工智能系统连接在一起,其中包括亚马逊自己的Titan模型以及Anthropic、Meta等开发的模型。

·亚马逊公布2023年第二财季财报,净销售额达到1344亿美元,同比增长11%,高于华尔街普遍预期。其中云计算部门表现亮眼,净销售额达到221亿美元,同比增长12%,略好于预期。

·“一场10公里的比赛,不能刚跑出几步就下结论谁将在比赛中领先。现在,生成式AI需要的是尝试、多样化选择和普惠化。”

美国东部时间8月3日,亚马逊(股票代码:AMZN)公布截至6月30日的2023年第二财季财报,净销售额达到1344亿美元,同比增长11%,高于华尔街普遍预期。每股利润为65美分,远高于华尔街预测的35美分。

其中云计算部门AWS(Amazon Web Services)表现亮眼,净销售额达到221亿美元,同比增长12%,比华尔街预期高出两个百分点。财报发布后,该公司股价在盘后交易中上涨约10%。截至常规交易收盘,亚马逊的股价今年已上涨一半以上,在大幅下跌后收复失地。

AI对收入增长的影响将在未来显现

亚马逊的云计算部门一直是该公司的关键。不过近几个月来,由于对经济持谨慎态度的企业审视其云账单,云服务商的增长放缓,AWS的12%销售增幅略好于预期。

在公布业绩后,亚马逊首席执行官安迪·贾西(Andy Jassy)在与分析师的电话会议上表示:“世界上每家公司都在努力节省尽可能多的资金。”

亚马逊首席财务官布莱恩·奥尔萨夫斯基(Brian Olsavsky)表示,这种“成本优化”仍在继续,但大公司正在重新拥抱云,这将在今年春季和夏季对该部门带来提振。 “虽然客户在第二季度继续优化,但我们开始看到越来越多的客户将注意力转向推动创新并将新的工作负载引入云。”

贾西指出,人工智能工作负载可能需要一段时间才能对收入增长产生有意义的影响,“我预计它会非常大,但会是在未来。”

实际上,生成式人工智能领域的火热已经让这些在淘金时代“卖铲子”的云计算供应商成为受益者。除AWS外,其竞争对手们也在较小的市场基础上实现了更大的跳跃:谷歌母公司Alphabet二季度云收入增长28%,微软云业务Azure二季度增长26%。

对于AWS是否在生成式AI热潮中慢了一步,亚马逊云科技首席执行官亚当·塞利普斯基(Adam Selipsky)对澎湃科技(www.thepaper.cn)表示,生成式AI目前处于非常早期的阶段,就像十公里比赛刚跑出几步。“就像回到1997年互联网正蓬勃发展时问,谁会是领先的互联网公司?大部分人的回答可能是AltaVista,这是一家当时占主导地位的搜索公司,然而,当今一代的年轻人可能对这个公司已经不太熟悉了。一场10公里的比赛,不能刚跑出几步就下结论谁将在比赛中领先。现在,生成式AI需要的是尝试、多样化选择和普惠化。”

塞利普斯基认为,生成式AI将给世界带来突破式的变革,且有可能是自互联网诞生以来最大的变革。互联网使知识普惠化,生成式AI将使人工智能技术普惠化。他特别举例称,艾伦研究所(Allen Institute)使用亚马逊云科技AI技术构建了有史以来第一个人脑地图,提供对脑部疾病的洞察,探究阿尔兹海默综合症和帕金森综合症等疾病发生的原因。

在财报电话会议上,贾西广泛谈论了该公司在AWS上提供的人工智能产品。他指出,该公司几年前推出了一款名为Trainium的定制人工智能训练芯片,以及另一款名为Inferentia的用于人工智能推理的芯片。贾西表示,他对未来大量大型语言模型训练和推理将在AWS的这两款芯片上运行感到乐观。

增加对人工智能项目基础设施的投资

奥尔萨夫斯基在电话会议上表示,该公司今年的资本支出将“略高于500亿美元”,低于2022年的590亿美元。该公司预计用于配送和运输的支出较上年有所下降,但这被对AWS用于人工智能项目基础设施的投资增加所抵消。

贾西表示,亚马逊在云计算、网络、存储、数据库和生成人工智能方面的投资,正在帮助企业利用亚马逊网络服务,进而推动其成为亚马逊业务的主要部分。

“生成式人工智能激发了人们的想象力,但大多数人都在谈论应用层。具体来说,就是OpenAI对ChatGPT所做的事情。请记住,重要的是,我们正处于生成式人工智能采用和成功的早期阶段,消费者应用程序只是机会的一层。”贾西说。

贾西认为,大型语言模型和生成式人工智能具有三个关键层,最底层是训练基础模型并进行推理或预测所需的计算。中间层是模型即服务,开发大型语言模型需要数十亿美元和多年的时间,大多数公司不喜欢自行消耗这些资源,而是使用自己的数据自定义这些模型,同时保护其专有数据。

“(亚马逊推出的)Bedrock服务提供所有上述功能,不仅仅是一种大型语言模型,还可以访问多个领先的大型语言模型公司,例如 Anthropic、Stability AI、AI21 Labs、Cohere 以及亚马逊自己开发的名为Titan的大型语言模型。”贾西说。AWS在纽约峰会上刚刚宣布了Bedrock的新功能,包括Cohere和Anthropic的新模型以及Stability AI的Stable Diffusion XL 1.0。

贾西认为,顶层是在大型语言模型之上运行的实际应用程序,这也是目前围绕生成式人工智能的大量宣传重点所在,ChatGPT就是一个典型例子。

塞利普斯基对澎湃科技在内的媒体介绍,亚马逊提供给客户的很多功能都是由机器学习驱动,例如电商推荐引擎、运营中心捡货机器人的路径选择,以及供应链、预测和产能规划。Prime Air(亚马逊无人机)和Amazon Go(亚马逊线下无人零售实体店)中的计算机视觉技术都使用了深度学习。

除了亚马逊云计算业务,按照服务和业务类型划分来看,其在线商店二季度的净销售额为529.96亿美元,与上年同期的508.55亿美元相比增长4%。实体店的净销售额为50.24亿美元,与上年同期的47.21亿美元相比增长6%。第三方卖家服务的净销售额为323.32亿美元,与上年同期的273.76亿美元相比增长18%。订阅服务的净销售额为98.94亿美元,同比增长14%。广告服务的净销售额为106.83亿美元,同比增长22%。来自其他业务的净销售额为13.44亿美元,同比增长26%。

展望未来,亚马逊预计第三季度销售额为1380亿美元至1430亿美元,同比增长9%至13%。该公司表示,该预测包括汇率上涨120个基点的有利影响。